Obstacles sur la voie de l'Open World App

Les services d'IA actuels comme ChatGPT montrent déjà à quoi ressemblent les interfaces de dialogue. Mais les systèmes du monde ouvert ne seront vraiment utiles que lorsqu'ils seront profondément liés au système d'exploitation, aux données personnelles, aux véhicules, à la maison intelligente et aux profils. Reste à savoir si nous voulons cette interconnexion omniprésente - mais ce n'est probablement qu'une question de temps avant que la technique ne mûrisse et que l'acceptation sociale ne suive.

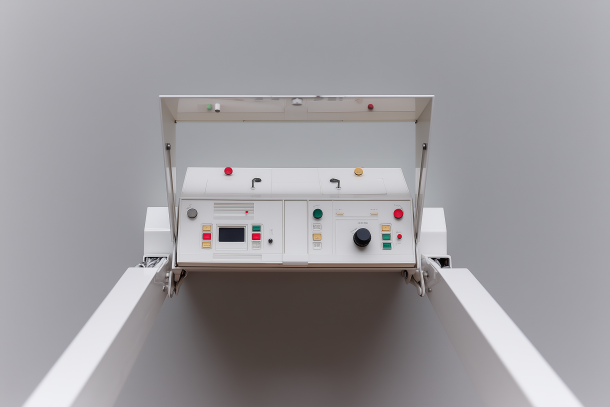

UX et confiance

Un système ouvert n'est utile que s'il reste simple. Les dialogues d'IA doivent être intuitifs et tolérants aux erreurs. Les résultats inattendus ne doivent pas être frustrants. La transparence aide: Les utilisateurs voient quelles données l'IA utilise et peuvent adapter les résultats. C'est ainsi que naît la confiance - justement parce que beaucoup de choses se passent en arrière-plan.

Interprétation ambiguë et erronée.

Le langage naturel est souvent vague. "Fais-moi une application de prise de notes comme Post-it" - simple liste de texte ou sticky-notes colorées avec alarme? L'IA comprend le contexte, mais ne devine pas tous les détails. Un mode de conversation clarifiant ("Les notes doivent-elles te rappeler?") permet d'éviter les malentendus. Pour cela, il faut un design d'interaction soigné, sinon le dialogue devient pénible.

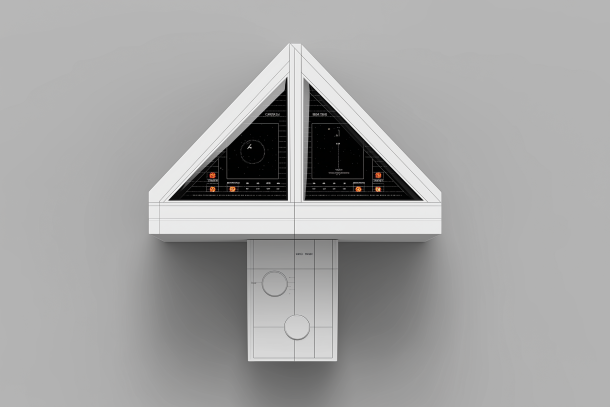

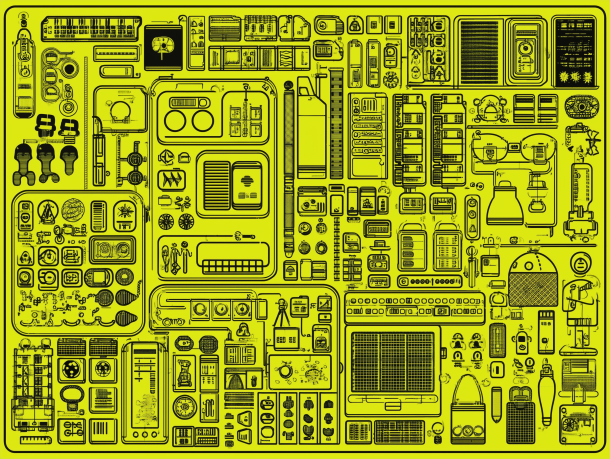

Modularité et ingénierie

Une véritable plateforme de monde ouvert a besoin de briques standardisées - caméra, saisie de données, diagramme, e-mail, etc. L'IA les assemble comme des briques de Lego. Le défi: couvrir d'innombrables combinaisons avec un nombre limité de modules ou créer des modules de manière dynamique. Les deux sont complexes et nécessitent des interfaces claires.

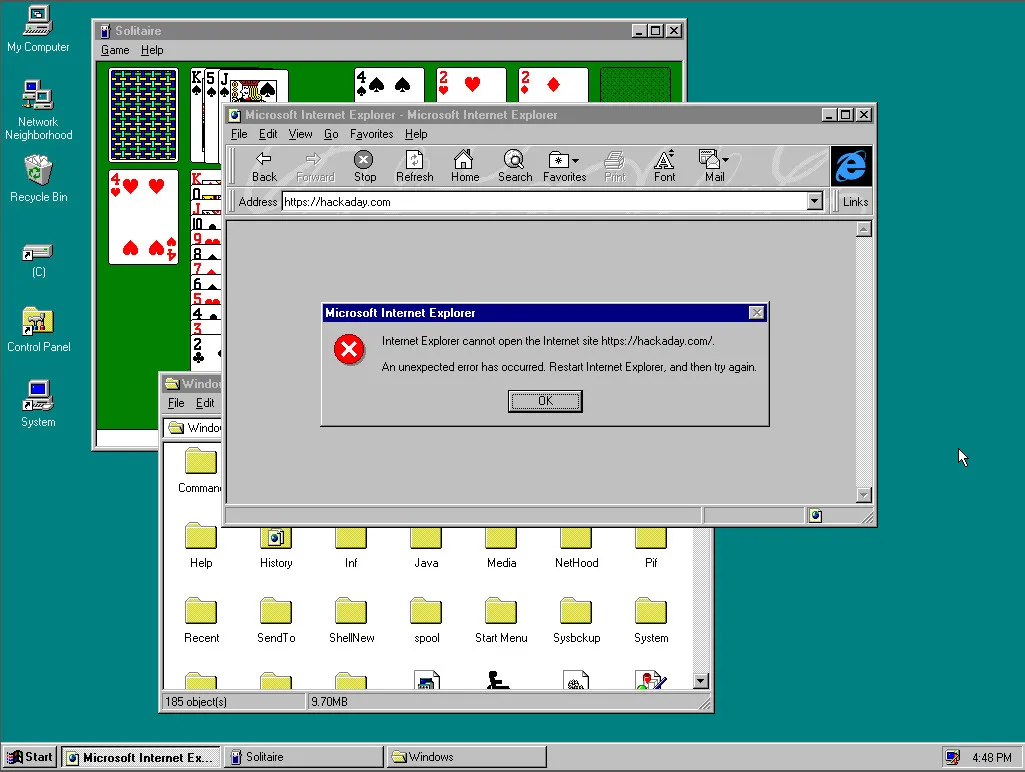

Assurance qualité et dépannage.

Les fonctions générées par les utilisateurs peuvent contenir des erreurs - description peu claire, ratés de l'IA. Qui corrigera les bugs si aucun développeur professionnel n'est derrière? La plateforme doit proposer des tests automatiques, des messages d'erreur et des mécanismes d'auto-guérison afin que les problèmes soient rapidement identifiés et corrigés.

Acceptation et courbe d'apprentissage

Pour beaucoup, le monde ouvert représente un changement de paradigme: au lieu de télécharger des applications prêtes à l'emploi, ils formulent eux-mêmes leurs souhaits. Cela nécessite des instructions et un système de suggestions qui aide à la formulation. Ce n'est que lorsque l'assistant, les données des appareils, les véhicules, la domotique et les profils seront reliés de manière transparente que le concept deviendra vraiment utilisable au quotidien - et que l'acceptation sociale pourra croître.

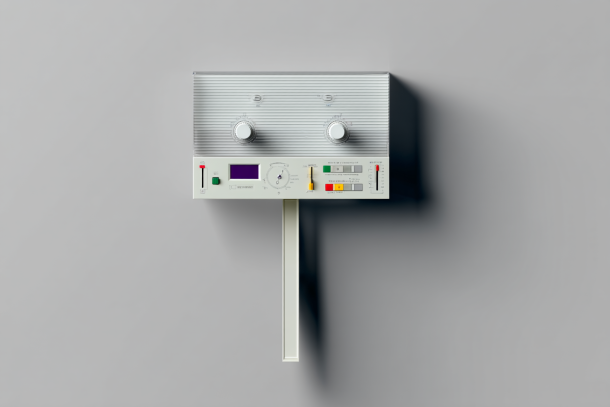

Sécurité & Éthique

Plus la plate-forme est ouverte, plus le risque d'abus est grand. L'IA ne doit pas divulguer de données sensibles, faire des propositions discriminatoires ou halluciner des instructions erronées. Des directives claires (par exemple selon l'EU-AI-Act), des filtres de contenu et des instances de contrôle humaines sont nécessaires pour garantir la confiance à long terme.

Un thème particulièrement critique est ici la prompt injection - c'est-à-dire le détournement ciblé d'instructions d'IA par des entrées manipulées. Cet article d'Arun Nair montre de manière impressionnante à quelle vitesse un système peut être induit en erreur si des mécanismes de sécurité font défaut.

De tels vecteurs d'attaque montrent l'importance des filtres de contenu, d'une délimitation robuste du contexte et d'une gouvernance claire du modèle. Le design doit également assumer une part de responsabilité dans ce domaine - par exemple par des limites d'interface intelligentes, des mécanismes de feedback et des processus de dialogue compréhensibles.