Hürden auf dem Weg zur Open World App

Aktuelle KI-Dienste wie ChatGPT zeigen bereits, wie sich Dialog-Interfaces anfühlen. Wirklich nützlich werden Open-World-Systeme aber erst, wenn sie tief mit Betriebssystem, persönlichen Daten, Fahrzeugen, Smart-Home und Profilen verknüpft sind. Ob wir diese allgegenwärtige Vernetzung wollen, bleibt offen – doch es ist wohl nur eine Frage der Zeit, bis die Technik reift und die gesellschaftliche Akzeptanz nachzieht.

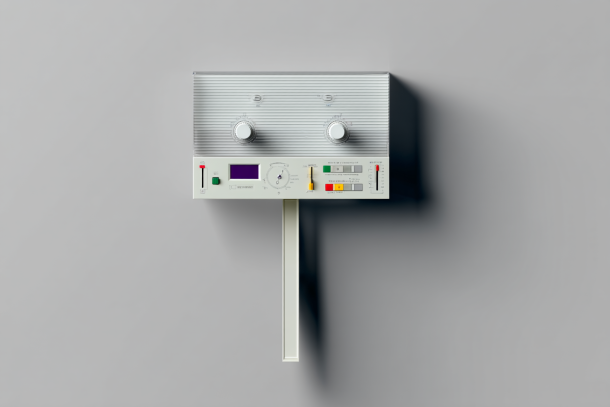

UX und Vertrauen

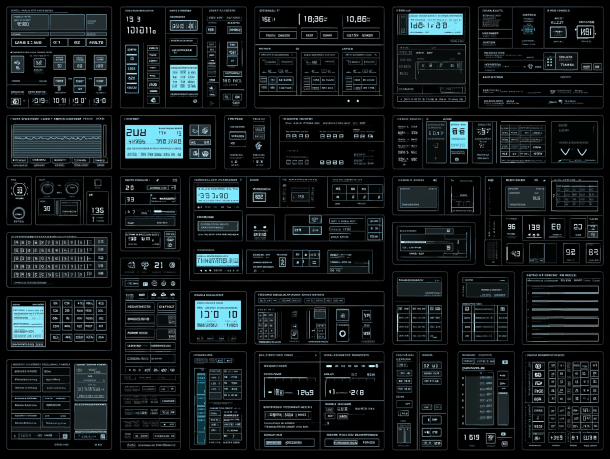

Ein offenes System nützt nur, wenn es einfach bleibt. KI-Dialoge müssen intuitiv und fehlertolerant sein. Unerwartete Ergebnisse dürfen nicht frustrieren. Transparenz hilft: Nutzer*innen sehen, welche Daten die KI nutzt und können Outputs anpassen. So entsteht Vertrauen – gerade weil vieles im Hintergrund passiert.

Mehrdeutigkeit und Fehlinterpretation

Natürliche Sprache ist oft vage. «Mach mir eine Notiz-App wie Post-it» – simple Textliste oder bunte Sticky-Notes mit Alarm? KI versteht Kontext, errät aber nicht jedes Detail. Ein klärender Gesprächsmodus («Sollen die Notizen erinnern?») fängt Missverständnisse ab. Dafür braucht es sorgfältiges Interaction Design, sonst wird der Dialog mühsam.

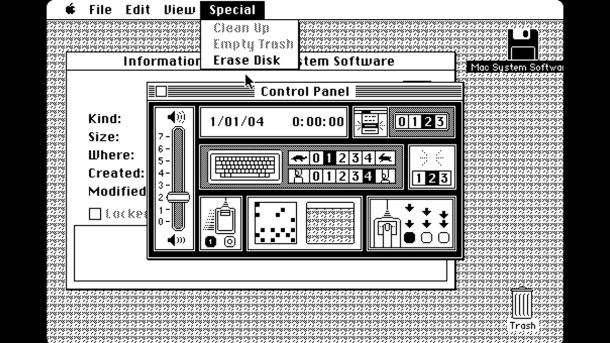

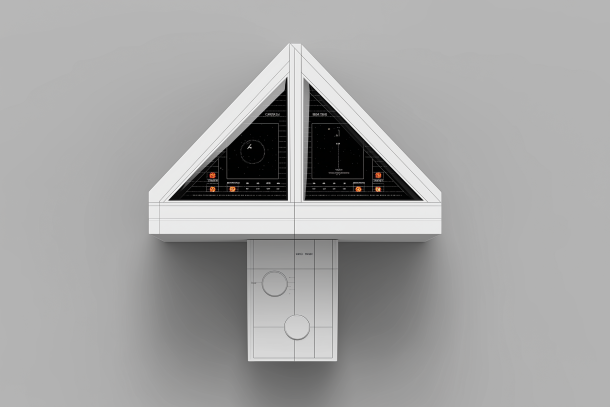

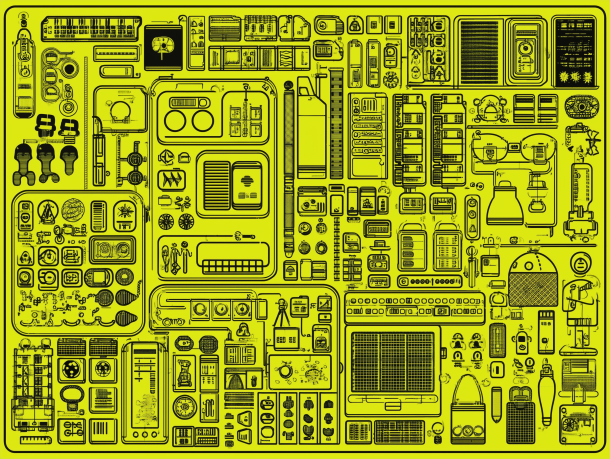

Modularität und Technik

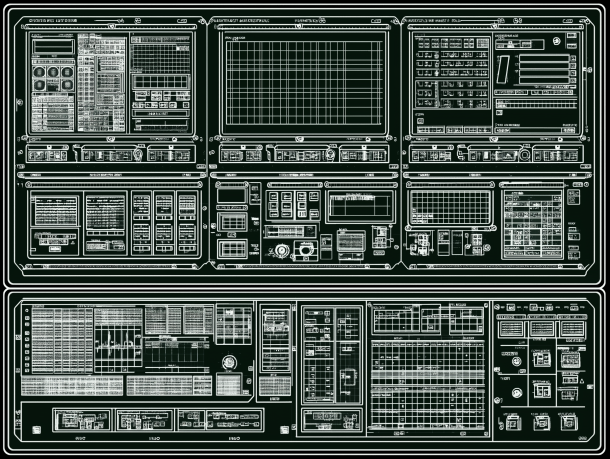

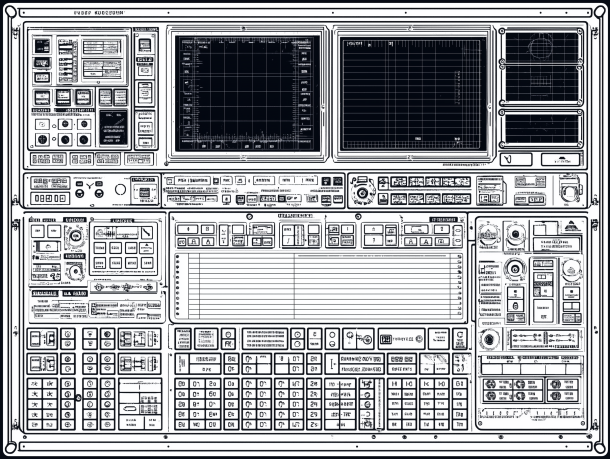

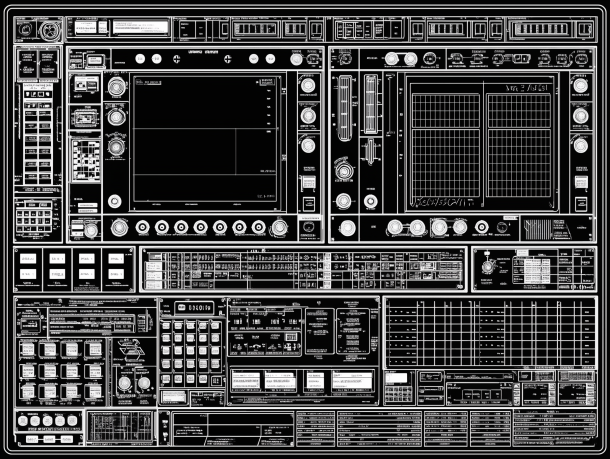

Eine echte Open-World-Plattform braucht standardisierte Bausteine – Kamera, Dateneingabe, Diagramm, E-Mail, und so weiter. Die KI setzt sie wie Lego Bausteine zusammen. Die Herausforderung: unzählige Kombinationen mit einer begrenzten Zahl von Modulen abdecken oder Module dynamisch erzeugen. Beides ist komplex und erfordert klare Schnittstellen.

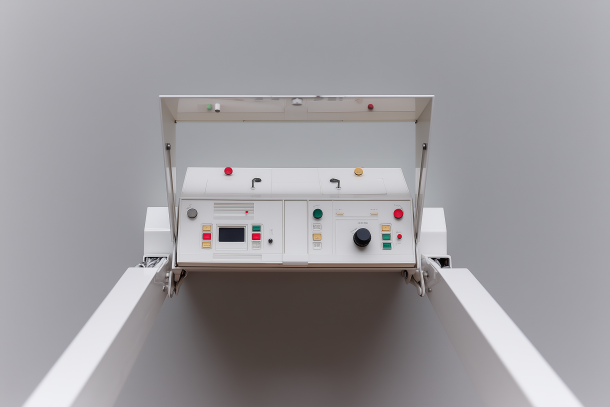

Qualitätssicherung und Fehlerbehebung

User*innen-generierte Funktionen können Fehler enthalten – unklare Beschreibung, KI-Aussetzer. Wer fixt Bugs, wenn keine professionelle Entwickler*innen dahinterstehen? Die Plattform muss automatische Tests, Fehlermeldungen und Self-Healing-Mechanismen bieten, damit Probleme schnell erkannt und korrigiert werden.

Akzeptanz und Lernkurve

Für viele bedeutet Open-World ein Paradigmenwechsel: Statt fertige Apps zu laden, formulieren sie selbst ihre Wünsche. Das braucht Anleitung und ein Vorschlags-System, das bei der Formulierung hilft. Erst wenn Assistent, Gerätedaten, Fahrzeuge, Haussteuerung und Profile nahtlos verknüpft sind, wird das Konzept wirklich alltagstauglich – und gesellschaftliche Akzeptanz kann wachsen.

Sicherheit & Ethik

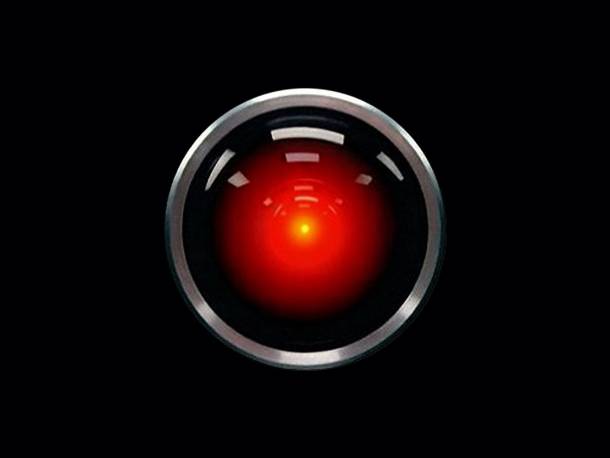

Je offener die Plattform, desto grösser das Missbrauchsrisiko. Die KI darf keine sensiblen Daten preisgeben, diskriminierende Vorschläge machen oder fehlerhafte Anweisungen halluzinieren. Klare Richtlinien (etwa nach EU-AI-Act), Content-Filter und menschliche Kontrollinstanzen sind nötig, um Vertrauen langfristig zu sichern.

Ein besonders kritisches Thema ist dabei die Prompt Injection – also das gezielte Unterwandern von KI-Anweisungen durch manipulierte Eingaben. Dieser Beitrag von Arun Nair zeigt eindrücklich, wie schnell ein System in die Irre geführt werden kann, wenn Sicherheitsmechanismen fehlen.

Solche Angriffsvektoren zeigen, wie wichtig Content-Filter, robuste Kontexteingrenzung und klare Modell-Governance sind. Design muss auch hier Verantwortung mittragen – etwa durch kluge Interface-Grenzen, Feedbackmechanismen und nachvollziehbare Dialogverläufe.